Resumo

A Pró-Reitoria de Graduação da PUC-Campinas, desde 2007, implantou um sistema de Avaliação do Ensino semestral realizado por estudantes e bianual, pelos professores, cujo escopo abrange as atividades dos docentes, da gestão e das condições de ensino. O objetivo desse artigo é apresentar um novo método de análise da série histórica dos resultados derivados das respostas dos estudantes. Para essa análise trabalhou-se com cinco categorias - plano de ensino da disciplina, desenvolvimento da disciplina, avaliação da aprendizagem, formação do aluno, postura do professor - e delas foram extraídos 19 aspectos incorporados nas questões. Mesmo que ao longo do tempo o questionário tenha passado por reformulações na sua redação, a essência dos elementos avaliativos, apresentados nessa análise, foi preservada. A qualidade obtida das respostas dadas para as questões fechadas configurou-se como um indicador definido para o modelo. Outro indicador diz respeito ao grau de participação dos alunos. Os dois indicadores podem ser observados juntos, em perspectiva bidimensional; é possível visualizar os dados obtidos em todos os semestres, o que mostra a tendência e a evolução de cada um dos aspectos em toda a série histórica. Os gráficos resultantes da aplicação deste modelo estabelecem um referencial visual que permite o rápido reconhecimento tanto das situações de excelência como de cenários de atenção, traduzindo-se em um mecanismo de rápida consulta e identificação por parte dos gestores e professores. A análise dos dados da série histórica tornou-se um importante instrumento para a melhoria da qualidade de ensino na Instituição.

Palavras-chave; Educação superior; Avaliação do ensino; Gestão da qualidade do ensino

Abstract

Since 2007, the PUC-Campinas has been implementing a Teaching Evaluation System, done every semester by students and biannually by teachers whose scope of activities involve management and teaching conditions. The aim of this article is to present a new analysis method of the historical series of results of student’s answers. For this analysis five categories were considered – teaching plan for the discipline, discipline development, learning evaluation, student’s training, teacher’s attitude. They were based on 19 aspects incorporated into the questions. Even though the questionnaire has suffered modifications over time, the nature of the evaluation elements was preserved. The quality of the given answers to the closed questions was set as an indicator to the model. The other indicator refers to the student’s level of participation. The two indicators can be observed together, in a two-dimensional perspective; it’s possible to see the data obtained every semester, showing the tendency and evolution of each aspect in all the historical series. The resulting graphs establish a visual reference, allowing a fast acknowledgment of the excellence situations, as well as attention scenarios, establishing a quick method of consultation for managers and teachers. The historical series data analysis has become an important tool for improving the teaching quality of the institution.

Key words; Highter education; Teaching evaluation system; Manegement of education Quality

1 Introdução

É salientado por Dias Sobrinho (2010)DIAS SOBRINHO, José. Avaliação e transformações da educação superior brasileira (1995-2009): do Provão ao SINAES. Avaliação, Campinas; Sorocaba, v. 5, n. 1, p. 195-224, 2010. a grande relevância da avaliação, considerada instrumento essencial não só para as reformas educacionais, mas também para as transformações da sociedade. O autor assume duas ideias centrais:

1) avaliação e transformações educacionais se interatuam, ou seja, a avaliação é um dos motores importantes de qualquer reforma ou modelação e, reciprocamente, toda mudança contextual produz alterações nos processos avaliativos; e

2) todas as transformações que ocorrem na educação superior e em sua avaliação fazem parte, de modo particular, porém, com enorme relevância, das complexas e profundas mudanças na sociedade, na economia e no mundo do conhecimento em âmbito global (p. 196)DIAS SOBRINHO, José. Avaliação e transformações da educação superior brasileira (1995-2009): do Provão ao SINAES. Avaliação, Campinas; Sorocaba, v. 5, n. 1, p. 195-224, 2010..

No contexto da educação superior brasileira, a trajetória histórica dos processos de avaliação institucional se inicia na década de 1980, com o Programa de Avaliação da Reforma Universitária (PARU) e a partir dos documentos gerados pela Comissão para a Reformulação da Educação Superior (GERES); se prolonga na década de 1990 com o Programa de Avaliação Institucional das Universidades Brasileiras (PAIUB) e com a criação, em 1996, do Exame Nacional de Curso (Provão). No entanto, na maioria das Instituições de Ensino Superior (IES), os processos avaliativos foram efetivados apenas em 2004 para atender às exigências da Lei 10.861/2004 que instituiu o Sistema Nacional de Avaliação da Educação Superior (SINAES).

Em sua concepção original, o SINAES busca construir um sistema nacional de avaliação da Educação Superior, tendo como base e eixo estruturante uma concepção de avaliação e educação global e integradora, propõe a integração entre diversos instrumentos e momentos de aplicação (DIAS SOBRINHO, 2010)DIAS SOBRINHO, José. Avaliação e transformações da educação superior brasileira (1995-2009): do Provão ao SINAES. Avaliação, Campinas; Sorocaba, v. 5, n. 1, p. 195-224, 2010.. Constituído por três componentes principais - avaliação das instituições, dos cursos e do desempenho dos estudantes - esse sistema “avalia todos os aspectos que giram em torno desses três eixos: o ensino, a pesquisa, a extensão, a responsabilidade social, o desempenho dos alunos, a gestão da instituição, o corpo docente, as instalações e vários outros aspectos” (INEP, 2009)INEP. SINAES. Disponível em: <http://www.inep.gov.br/superior/SINAES>. 2004. Acesso em: 20 out. 2009.

http://www.inep.gov.br/superior/SINAES...

. Nessa concepção de avaliação, Brito (2008)BRITO, Márcia Regina Ferreira de. O SINAES e o ENADE: da concepção à implantação. Avaliação, Campinas; Sorocaba, v. 13, n. 3, p. 841-850, 2008. destaca ser fundamental que se reconheça o respeito à identidade e à diversidade.

Pela primeira vez foi instaurado um sistema, com ações avaliativas interligadas, com o objetivo de ‘olhar’ o todo através das suas partes (POLIDORI; FONSECA; LARROSA, 2007)POLIDORI, Malis Morosini; FONSECA, Denise Grosso da; LARROSA, Sara Fernanda Tarteer. Avaliação institucional participativa. Avaliação, Campinas, Sorocaba, v. 12, n. 2, p. 333-348, 2007., de modo que seus resultados proporcionam um panorama da qualidade dos cursos e das instituições de educação superior no país (INEP, 2009)INEP. SINAES. Disponível em: <http://www.inep.gov.br/superior/SINAES>. 2004. Acesso em: 20 out. 2009.

http://www.inep.gov.br/superior/SINAES...

.

Na perspectiva da construção de um sistema, o SINAES se propôs como política de Estado, com dupla função: a função regulatória – autorizar, credenciar e reconhecer cursos e IES – e a função formativa – avaliar, incentivar e garantir qualidade dos cursos oferecidos.

A fim de cumprir a dupla função do Estado, a avaliação não pode resumir-se à “aplicação direta e mecânica de uma metodologia, nem tampouco a obediência cega às diretrizes e aos roteiros preestabelecidos” (p. 63), necessitando ser um processo contextualizado, conforme destaca Ribeiro (2011)RIBEIRO, Jorge Luiz Lordêlo de Sales. Avaliação das Universidades Brasileiras: as possibilidades de avaliar e as dificuldades de ser avaliado. Avaliação, Campinas; Sorocaba, v. 16, n. 1, p. 57-71, 2011..

As informações obtidas com o SINAES são utilizadas pelos órgãos governamentais para orientar políticas públicas. Também são úteis aos estudantes, seus familiares, instituições acadêmicas e o público em geral, para orientar suas decisões quanto aos cursos e às instituições. Além disso, servem às IES, “para orientação da sua eficácia institucional e efetividade acadêmica e social” (INEP, 2009)INEP. SINAES. Disponível em: <http://www.inep.gov.br/superior/SINAES>. 2004. Acesso em: 20 out. 2009.

http://www.inep.gov.br/superior/SINAES...

.

No entanto, de acordo com Dias Sobrinho (2010)DIAS SOBRINHO, José. Avaliação e transformações da educação superior brasileira (1995-2009): do Provão ao SINAES. Avaliação, Campinas; Sorocaba, v. 5, n. 1, p. 195-224, 2010., nos últimos anos, nos exames em larga escala com funções de controle e regulação, a avaliação tem sido um fim em si mesmo. “As práticas exclusivamente controladoras e tecnicistas de fontes governamentais não contribuem para construir nas instituições os espaços de questionamento e reflexão sobre suas atividades e seus compromissos sociais” (p. 218)DIAS SOBRINHO, José. Avaliação e transformações da educação superior brasileira (1995-2009): do Provão ao SINAES. Avaliação, Campinas; Sorocaba, v. 5, n. 1, p. 195-224, 2010.. As instituições acabam se desestimulando a levar adiante os processos de avaliação institucional, e o processo avaliativo tem perdido seu caráter educativo de diagnóstico e de busca de aprimoramento.

Ribeiro (2011)RIBEIRO, Jorge Luiz Lordêlo de Sales. Avaliação das Universidades Brasileiras: as possibilidades de avaliar e as dificuldades de ser avaliado. Avaliação, Campinas; Sorocaba, v. 16, n. 1, p. 57-71, 2011. pontua que a despeito dos desafios e dificuldades no processo de avaliação das instituições universitárias, na atualidade, é nítido o reconhecimento de sua importância. Há consenso sobre sua necessidade, independentemente de qual seja o modelo de avaliação adotado ou os critérios determinados.

Polidori, Marinho-Araujo e Barreyro (2006)POLIDORI, Marlis Morosini; MARINHO-ARAUJO, Clayse Maria; BARREYRO, Gladys Beatriz. SINAES: perspectivas e desafios na avaliação da educação superior brasileira. Ensaio, Rio de Janeiro, v. 14, n. 53, p.425-436, 2006., também sustentam que o SINAES representa um avanço quanto ao modelo de avaliação da educação superior, embora ainda haja muitos desafios a serem superados. Apontam que o sistema beneficia a difusão de uma cultura da avaliação que não se resume ao ranqueamento das instituições, mas também não o impede. Outro desafio destacado pelas autoras refere-se à realização efetiva da autoavaliação institucional.

Para Dias Sobrinho (2010, p. 218)DIAS SOBRINHO, José. Avaliação e transformações da educação superior brasileira (1995-2009): do Provão ao SINAES. Avaliação, Campinas; Sorocaba, v. 5, n. 1, p. 195-224, 2010.:

A avaliação se completa quando vai além dos índices e escalas comparativas e engendra questionamentos a respeito das significações e valores, interroga sobre as causas e investe em programas e ações para superar os problemas e deficiências. Por isso, não está somente voltada ao já realizado; precisa estar aberta à construção do futuro, a novas interpretações e possibilidades.

Para algumas IES, a avaliação institucional pode estar sendo efetivada apenas para atender às exigências postas. No entanto, outras instituições têm utilizado a dinâmica e os mecanismos propostos para se autoconhecerem e se autogerirem (POLIDORI; FONSECA; LARROSA, 2007)POLIDORI, Malis Morosini; FONSECA, Denise Grosso da; LARROSA, Sara Fernanda Tarteer. Avaliação institucional participativa. Avaliação, Campinas, Sorocaba, v. 12, n. 2, p. 333-348, 2007..

Meyer Junior e Barbosa (2006)MEYER JUNIOR, Victor; BARBOSA, Vera Maria. Avaliação docente: contribuição para a qualidade das instituições de Educação Superior. UNIrevista, São Leopoldo, v. 1, n. 2, 2006. sustentam que, no processo de análise qualidade e do desempenho institucional, a área acadêmica constitui-se em uma das que têm maior importância, com destaque particular para a avaliação do trabalho acadêmico desenvolvido pelos professores.

Neste contexto, a Pró-Reitoria de Graduação da PUC-Campinas iniciou, a partir de 2007, um processo de avaliação semestral e permanente do ensino, que engloba as dimensões das atividades do docente, da gestão e das condições de ensino. São finalidades da Avaliação do Ensino diagnosticar, redefinir metas e acertar rotas para manter a missão da PUC-Campinas, de proporcionar um ensino de qualidade, garantindo a formação integral de um cidadão crítico e atualizado em relação às necessidades sociais e às exigências profissionais. Atualmente, a PUC-Campinas conta com 41 cursos de graduação e seis tecnológicos, com um universo de cerca de 800 professores e aproximadamente 18.000 alunos.

Para atingir esses objetivos, e também contemplar as exigências legais, houve a necessidade de se avaliar o ensino na Universidade de uma maneira global e sistemática, pois as avaliações feitas anteriormente foram pontuais e não tiveram continuidade. Em 2006, foi constituído um Grupo de Trabalho pela Pró-Reitoria de Graduação (PROGRAD) com a finalidade de criar instrumentos de avaliação para os alunos e para os professores. Esses instrumentos foram construídos com a participação dos diretores dos Centros (Centro de Ciências Humanas e Sociais Aplicadas - CCHSA; Centro de Ciências da Vida - CCV; Centro de Economia e Administração - CEA; Centro de Ciências Exatas Ambientais e Tecnológicas - CEATEC; Centro de Linguagem e Comunicação - CLC), diretores das Faculdades e Cursos, professores, alunos, associação dos docentes. Tem sido aplicado semestralmente para os alunos, desde 2007, e bianualmente para professores, desde 2008.

O início deste processo foi descrito na edição no 04 da revista Cadernos de Avaliação (A CONSTITUIÇÃO..., 2007)A CONSTITUIÇÃO do Grupo de Trabalho “Avaliação do Ensino”: diretrizes, metodologia, objetivos e atribuições das instâncias envolvidas. Cadernos de Avaliação, Campinas, n. 4, p. 19-22, 2007.. Na edição n. 6 da mesma revista (LEMOS FILHO et al., 2009)LEMOS FILHO, Arnaldo; PÁDUA, Elisabete Matallo Marchesini de; BARIANI, Isabel Cristina Dib; RODRIGUES, Kátia Regina Martini; MEGID, Maria Auxiliadora Bueno Andrade. Avaliação docente: Um importante componente do processo de auto-avaliação institucional. Cadernos de avaliação, Campinas, n. 6, p. 21-53, 2009. , foi publicado um artigo apresentando o instrumento concebido para a Avaliação do Ensino por parte dos docentes e são descritos os principais resultados obtidos com a sua aplicação. Além disso, análises comparativas dos resultados obtidos nas avaliações discentes e docentes encontram-se em Lemos Filho et al. (2012)LEMOS FILHO, Arnaldo; BARIANI, Isabel Cristina Dib; FRANÇA, Carlos Marshal; TREVISAN, Claudia Lúcia; GRANJA, Ivan; RODRIGUES, Kátia Regina Martini; PÁDUA, Elisabete Matallo Marchesini de. Avaliação do ensino: quando alunos e professores se avaliam. Cadernos de Avaliação, Campinas, n. 10, p. 37-49, 2012..

No presente artigo é apresentado um novo método de análise da série histórica de resultados, que foi criado pelo Grupo de Trabalho ‘Avaliação do Ensino’. Faz uma proposta de transformar os dados quantitativos dos resultados das avaliações semestrais em dados qualitativos, enfatizando a qualidade do trabalho docente em sala de aula.

Trata-se de uma proposta ousada, pois como lembra Ribeiro (2011)RIBEIRO, Jorge Luiz Lordêlo de Sales. Avaliação das Universidades Brasileiras: as possibilidades de avaliar e as dificuldades de ser avaliado. Avaliação, Campinas; Sorocaba, v. 16, n. 1, p. 57-71, 2011. é difícil discutir o conceito de qualidade. Para ele, o entendimento do próprio conceito é um dos obstáculos enfrentados pelas comissões para avaliar as instituições universitárias, pois não há consenso sobre o seu significado. E cita Vroeijenstijin (1996), para quem procurar uma definição de qualidade é perda de tempo. Ribeiro ainda aponta que, embora o artigo 206 da Constituição de 88 e o artigo 4 da LDB determinam que “a garantia de padrão de qualidade” é um dos princípios da educação, devem ser considerados alguns questionamentos propostos por Santana (2007)SANTANA, Flávia Feitosa. A dinâmica da aplicação do termo qualidade na educação superior brasileira. São Paulo: Senac, 2007.: Qualidade do quê? Para quê? Para quem? Como?

Contudo é preciso estabelecer uma relação entre a avaliação e a utilização do termo qualidade. Ribeiro (2011)RIBEIRO, Jorge Luiz Lordêlo de Sales. Avaliação das Universidades Brasileiras: as possibilidades de avaliar e as dificuldades de ser avaliado. Avaliação, Campinas; Sorocaba, v. 16, n. 1, p. 57-71, 2011. destaca que, no ensino superior, o número de alunos, o tempo de conclusão dos cursos, a relação entre o planejamento e a execução das atividades acadêmicas, a qualificação do corpo docente, a produção científica dos alunos e professores, a taxa de reprovação e a taxa de conclusão do curso são aspectos que também podem ser enfocados para expressar qualidade.

Em que pese a falta de consenso entre os autores sobre o conceito de qualidade, tem-se buscado, no projeto Avaliação do Ensino da PUC-Campinas, trabalhar de forma integrada os resultados, considerando tanto o ponto de vista quantitativo como o qualitativo.

A seguir é descrito o novo modelo de análise da série histórica de resultados, o qual foi implantado a partir de 2012.

2 O método de análise da série histórica – apresentação do modelo

Desde o início do processo de Avaliação do Ensino na PUC-Campinas, no 1º semestre de 2007, sucessivas alterações ocorreram no Instrumento que é aplicado na dimensão de “Avaliação do Professor”. A princípio, seu objetivo foi introduzir novos elementos avaliativos que não eram considerados na versão original e melhorar a redação de parte das questões apresentadas.

A versão atual do instrumento dos alunos é composta por questões de autoavaliação e de avaliação do docente, ou seja, propõe-se à avaliação de características acadêmicas dos alunos e de características da prática docente. Há, ainda, espaços disponíveis para a redação de ‘considerações gerais’.

Desse modo, superados os desafios do início do processo, novos esforços foram realizados no sentido da clareza e pertinência, visando permitir o agrupamento das questões então propostas em cinco categorias: Plano de Ensino da Disciplina; Desenvolvimento da Disciplina; Avaliação da Aprendizagem; Formação do Aluno; e Postura do Professor, de modo a dar um sentido lógico à sequência de preenchimento do instrumento.

Nessas ocasiões, houve sempre grande cuidado em manter a essência dos elementos avaliativos, buscando possibilitar uma análise dos dados quantitativos obtidos em uma perspectiva de série histórica. Essa decisão mostrou-se fundamental, pois ensejou a possibilidade de organizar os dados quantitativos em um nível mais granular, denominado aspecto.

2.1 O Conceito de Aspecto

No âmbito deste trabalho, define-se aspecto como um elemento avaliativo contido no instrumento de avaliação, cuja essência pode ser encontrada em várias de suas versões durante a série histórica.

Essa definição foi cunhada partindo-se dos materiais produzidos na primeira análise da série histórica (LEMOS FILHO et al., 2012)LEMOS FILHO, Arnaldo; BARIANI, Isabel Cristina Dib; FRANÇA, Carlos Marshal; TREVISAN, Claudia Lúcia; GRANJA, Ivan; RODRIGUES, Kátia Regina Martini; PÁDUA, Elisabete Matallo Marchesini de. Avaliação do ensino: quando alunos e professores se avaliam. Cadernos de Avaliação, Campinas, n. 10, p. 37-49, 2012., da qual desdobrou-se um processo mais aprofundado de avaliação das diversas versões do instrumento, cujo método de análise reconstruiu a série histórica de trás para frente, partindo-se de cada questão contida na versão mais recente do instrumento em busca das equivalentes nas versões mais antigas da série.

Nesse processo de reconstrução verificou-se que os elementos avaliativos de dezenove aspectos estavam preservados durante a série histórica, ainda que a numeração, a quantidade e/ou redação das questões e dos respectivos itens de respostas tenham sofrido alterações no transcorrer dos semestres. Uma visão geral das cinco categorias e dos 19 aspectos preservados pode ser contatada no Quadro 1.

Concluiu-se, deste esforço, que um aspecto pode ser considerado preservado mesmo que tenha havido alteração de redação ou modificação de termos e/ou palavras empregadas no instrumento. Como exemplo, “exposição lógica e clara” e “domínio do conteúdo” são aspectos que vêm sendo avaliados pelos alunos desde o início do processo de Avaliação do Ensino, no ano de 2007, embora os formulários utilizados desde então tenham passado por alterações em seu formato.

No instrumento aplicado no último semestre de 2009, esses aspectos eram avaliados na 7ª questão, cujas possíveis repostas eram:

-

MESMO NÃO TENDO EXPOSIÇÃO LÓGICA E CLARA – Tem domínio do conteúdo embora não consiga desenvolvê-lo com clareza e objetividade;

-

NÃO TEM EXPOSIÇÃO LÓGICA E CLARA - Não tem domínio do conteúdo e não consegue desenvolvê-lo com clareza e objetividade;

-

TEM EXPOSIÇÃO LÓGICA E CLARA - Tem boa didática e desenvolve o conteúdo da disciplina em linguagem clara, apresentando um raciocínio lógico, possível de ser acompanhado pelo aluno. Após a última reformulação do instrumento, ocorrida no 1º semestre de 2010, esses aspectos passaram a ser avaliados na categoria Desenvolvimento da Disciplina que corresponde à 4ª questão do formulário, cujas possíveis respostas são:

-

DOMINA O CONTEÚDO E TEM EXPOSIÇÃO LÓGICA E CLARA;

-

DOMINA O CONTEÚDO, MAS NÃO TEM EXPOSIÇÃO LÓGICA E CLARA;

-

NÃO DOMINA O CONTEÚDO, EMBORA TENHA UMA EXPOSIÇÃO LÓGICA E CLARA;

-

NÃO DOMINA O CONTEÚDO E NÃO TEM EXPOSIÇÃO LÓGICA E CLARA.

Dessa maneira é possível verificar que a essência desses elementos avaliativos está mantida, ainda que a redação tenha sido modificada no processo de evolução das versões do instrumento.

2.2 Os indicadores de qualidade dos aspectos

Uma vez definidos os aspectos preservados ao longo da série histórica de todo o processo de Avaliação do Ensino, tornou-se necessário identificar quais as respostas são indicativas de qualidade para cada um dos aspectos, independentemente da forma como os dados tenham sido recolhidos ao longo da série histórica, mesmo que o instrumento tenha sofrido alterações. Para exemplificar, tome-se como referência o aspecto “Exposição lógica e clara”. É possível verificar, nas duas últimas versões do instrumento, nas Ilustrações 1 e 2, quais respostas são indicativas de qualidade (quadros preenchidos com pontos) e quais são indicativas de não qualidade (quadros preenchidos por hachuras).

Ilustração 1 - Respostas indicativas de qualidade e de não qualidade para o aspecto “Exposição Lógica e Clara”, no Instrumento aplicado no 1º semestre de 2009.

-

MESMO NÃO TENDO EXPOSIÇÃO LÓGICA E CLARA – Tem domínio do conteúdo embora não consiga desenvolvê-lo com clareza e objetividade;

-

NÃO TEM EXPOSIÇÃO LÓGICA E CLARA - Não tem domínio do conteúdo e não consegue desenvolvê-lo com clareza e objetividade;

-

TEM EXPOSIÇÃO LÓGICA E CLARA - Tem boa didática e desenvolve o conteúdo da disciplina em linguagem clara, apresentando um raciocínio lógico, possível de ser acompanhado pelo aluno.

Ilustração 2 - Respostas indicativas de qualidade e de não qualidade para o aspecto “Exposição Lógica e Clara”, no Instrumento aplicado a partir do 1º semestre de 2010

-

DOMINA O CONTEÚDO E TEM EXPOSIÇÃO LÓGICA E CLARA

-

DOMINA O CONTEÚDO, MAS NÃO TEM EXPOSIÇÃO LÓGICA E CLARA

-

NÃO DOMINA O CONTEÚDO, EMBORA TENHA UMA EXPOSIÇÃO LÓGICA E CLARA

-

NÃO DOMINA O CONTEÚDO E NÃO TEM EXPOSIÇÃO LÓGICA E CLARA

Do mesmo modo, os indicadores de qualidade para o aspecto “Domínio do Conteúdo” podem ser identificados a partir das Ilustrações 1 e 2 há pouco referidas. Isso evidencia que as dificuldades oriundas das mudanças pelas quais passou o instrumento de coleta de dados, ao longo do tempo, podem ser contornadas com a adequada identificação dos aspectos e, em cada um deles, dos elementos indicativos de sua qualidade. De maneira análoga, outros dezessete aspectos da avaliação do ensino puderam ser preservados na série histórica, totalizando-se os dezenove que estão listados no Quadro 1.

A qualidade obtida das respostas dadas para as questões fechadas configura o primeiro indicador definido para o modelo. Considerando o compromisso da PUC-Campinas na busca pela excelência nas suas opções estratégicas, conforme especificado no Plano de Desenvolvimento Institucional e Planejamento Estratégico da PUC-Campinas, também foram adotadas quatro classes de valores para esse indicador:

-

Excelente - respostas indicativas de qualidade superarem ou igualarem 90%;

-

Bom - respostas indicativas de qualidade entre 70% (inclusive) e 90%;

-

Razoável - respostas indicativas de qualidade entre 50% (inclusive) e 70%;

-

Insatisfatório - respostas indicativas de qualidade abaixo de 50%.

A adoção das classes para esse indicador traduz-se em um mecanismo de rápida consulta e identificação, por parte dos gestores, ou mesmo dos professores em nível de autogestão, dos aspectos que tiveram boa avaliação no último período de avaliação, dos que estão em níveis indesejados, valores médios e frequências daquele período avaliativo.

A estruturação do modelo tal como apresentada já seria suficiente para permitir a recuperação e reorganização das informações numa série histórica que preservou, por assim dizer, os resultados da avaliação em cada um dos momentos em que tenha sido realizada. Ademais, tais informações podem ser facilmente visualizadas por meio de gráficos de linhas sobre a evolução de cada aspecto nos vários semestres ou evolução da média dos aspectos nos semestres, ou gráficos de barras na comparação de vários aspectos em um mesmo semestre. Os anexos (B 1 Recorte de Dados do Gráfico: PUC-Campinas ), (C 1 Recorte de Dados do Gráfico: PUC-Campinas ), (D 1 Recorte de Dados do Gráfico: PUC-Campinas ) e (E 1 Recorte de Dados do Gráfico: PUC-Campinas ) exemplificam esses gráficos.

2.3 Os Indicadores de qualidade da participação do alunado

A experiência de vários anos no processo de Avaliação do Ensino demonstrou também a importância de considerar-se o grau de participação dos alunos como um elemento fundamental para a construção da avaliação do ensino enquanto um efetivo instrumento de gestão acadêmica. Por isso, incorporou-se ao presente modelo o grau de participação dos alunos, traduzido também como outro indicador objetivo.

Considerando o caráter censitário, aberto a todos os alunos, e por adesão do processo avaliativo, foram adotadas quatro classes de valores possíveis:

-

Participação insatisfatória - até 24,99%;

-

Participação satisfatória - de 25% a 39,99%;

-

Participação significativa - de 40% e 59,99%;

-

Participação muito significativa - acima de 60%.

A adoção dessas classes traduz-se em um mecanismo efetivo de verificação e mensuração da cultura de avaliação na Instituição, bem como para avaliação da evolução e do comportamento deste critério no tempo.

A escolha de “significativo” e “muito significativo”, para as duas últimas classes de valores, deveu-se pelo significado intrínseco dessas palavras como sinalizadoras de patamares quantitativos em uma desejada cultura de avaliação, não havendo conotação estatística no modelo, particularmente por não haver uso de amostras no processo.

O conjunto dos dois indicadores há pouco mencionados permite comparar dados com os obtidos nos semestres imediatamente anteriores, subsidiar o planejamento e execução de ações de correção de rumos ou de melhoria contínua, avaliar a eficácia dessas ações planejadas, bem como verificar a tendência e a evolução do comportamento dos aspectos em toda a série histórica.

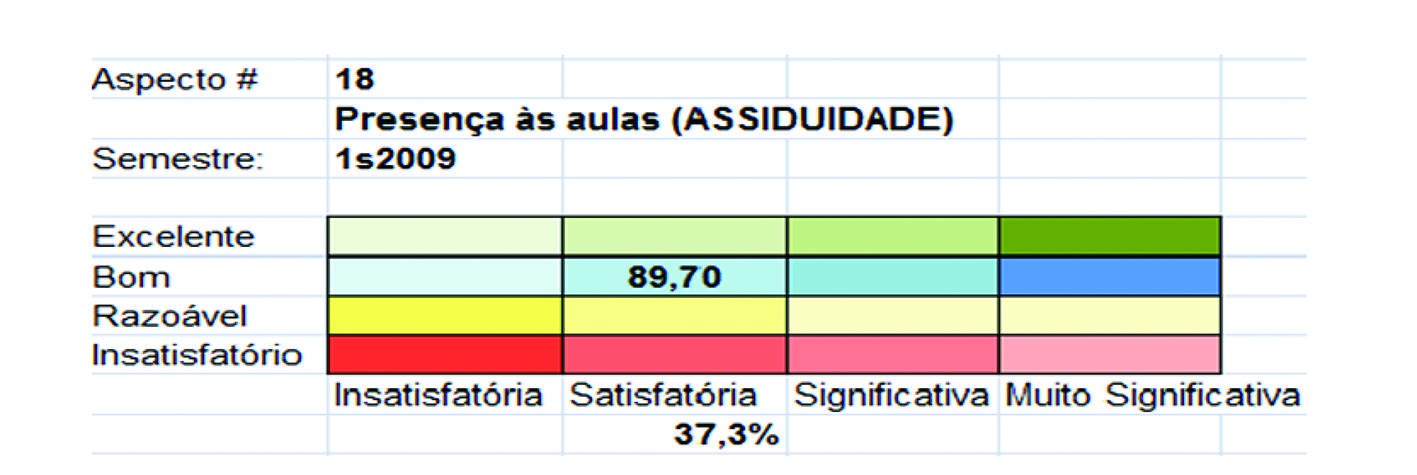

2.4 Aplicando os Indicadores em Perspectiva Bidimensional

Ainda que úteis individualmente, os dois indicadores definidos possuem uma relação muito forte entre si, havendo a possibilidade de serem observados juntos, em perspectiva bidimensional. A Figura 1 apresenta esse modo de visualização cartesiana, no qual o eixo x (abscissas) foi destinado para as classes que compõem o indicador de ‘qualidade participação’ do alunado e o eixo y (ordenadas) para as classes relativas à ‘qualidade dos aspectos’. Definiu-se que a visualização desse novo modelo, em perspectiva bidimensional, seria feito por meio de cores e tonalidades, da esquerda para a direita: da mais clara para a mais escura, os indicadores excelente e bom; e do mais escuro para o mais claro os indicadores razoável e insatisfatório. No eixo x aplica-se a mesma lógica de graduação: de baixo para cima, do mais escuro para o mais claro para os indicadores ‘insatisfatória e satisfatória’; e, alto para baixo, do mais escuro para o mais claro para os indicadores de ‘significativa e muito significativa’.

Para cada classe indicadora de qualidade de aspecto (eixo y), uma cor foi definida: vermelho para insatisfatório, amarelo para razoável, azul para bom e verde para excelente, cada qual com quatro tonalidades diferentes, cuja gradação representa as classes de qualidade Participação dos alunos (eixo x), conforme ilustra a Figura 1. O uso de cores e tonalidades, relacionados às classes indicativas de qualidade dos aspectos e da participação permite uma rápida visualização da intersecção dos dois indicadores originais e, por consequência, a classificação conjunta dos dois indicadores em uma única e exclusiva classe possível.

Estabelece-se, assim, um referencial visual que permite o rápido reconhecimento tanto das situações de excelência como de cenários de atenção. No indicador de cores, o verde escuro corresponde a um aspecto com mais de 90% de respostas indicativas de qualidade e participação dos alunos acima de 60%. Já o vermelho mais escuro representa participação abaixo de 25% e qualidade das respostas inferior a 50%.

A Figura 2 mostra como exemplo os resultados do aspecto nº 18 obtidos no ano de 2009. Nesse semestre letivo, a participação dos alunos foi de 37,3% e as respostas indicativas de qualidade para o aspecto nº 18 somaram 89,70%. Juntas, o indicador de cor corresponde ao azul, no segundo nível de tonalidade.

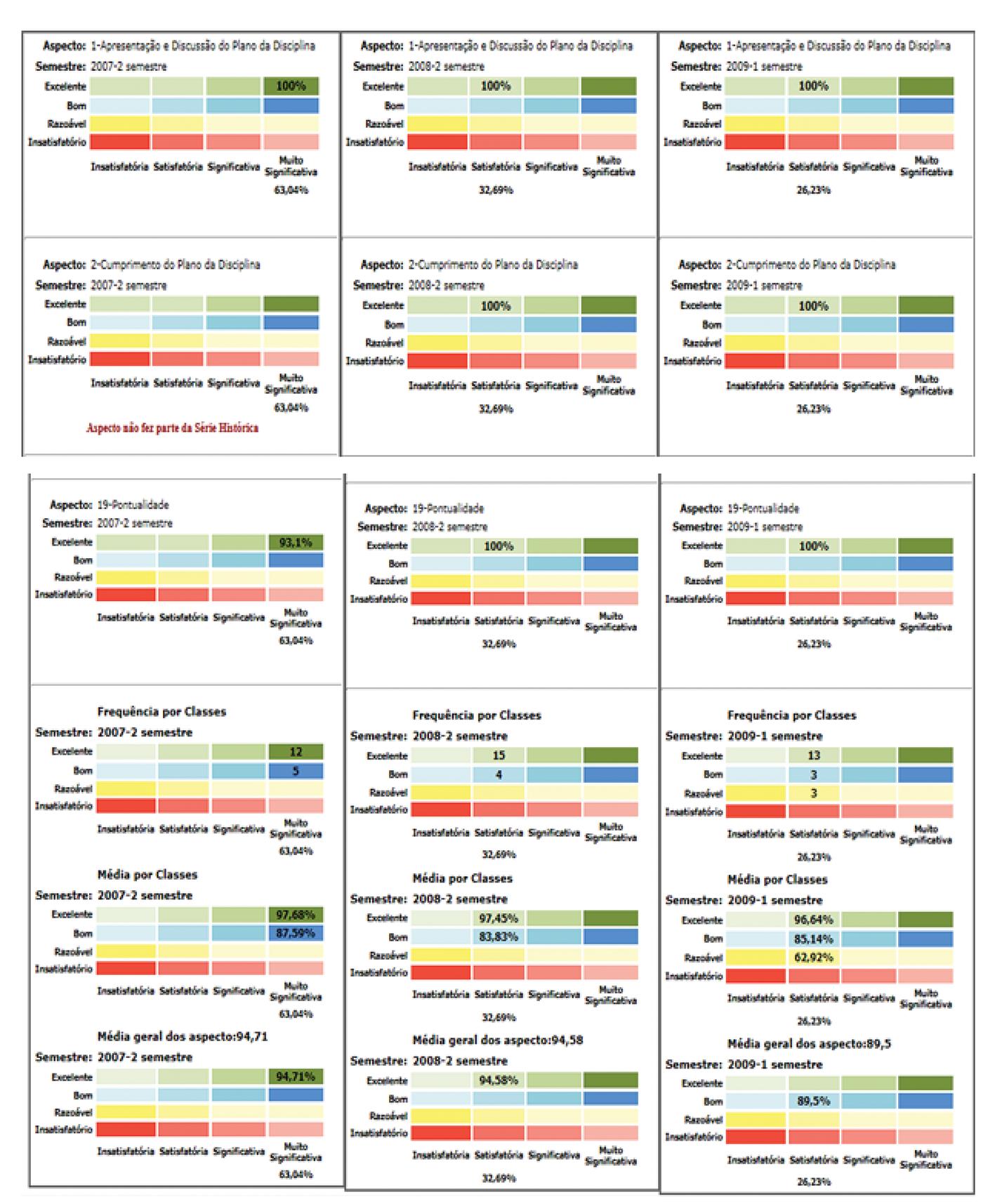

Além de útil para análises individualizadas sobre cada um dos 19 aspectos, o modelo permite o uso desse indicador para avaliação da média geral dos aspectos em um semestre letivo, frequência de ocorrência de aspectos em cada uma das 16 classes de cores/tonalidades, bem como a média de qualidade em cada uma dessas classes, conforme mostram, respectivamente, os elementos da Figura 3.

–Indicadores em Perspectiva Bidimensional para a Média Geral dos Aspectos, Frequência e de Classes e Média das Classes

O modelo também permite avaliação do indicador bidimensional na série histórica, o que permite avaliar diversos pontos:

-

Há impacto das variações do nível de participação dos alunos a cada semestre letivo na qualidade das respostas fechadas?

-

Qual a tendência da qualidade na série histórica?

-

Qual a tendência da participação dos alunos na série histórica?

-

Qual a tendência do binômio participação/qualidade na série histórica?

A Figura 4 mostra, parcialmente, o indicador em uma série histórica. Ao percorrer uma mesma coluna, os dados de todos os 19 aspectos daquele semestre são mostrados um a um, sendo os dados finais referentes aos dados consolidados (frequência de aspectos em cada classe, a média de cada uma das classes e a média geral de todos os aspectos daquele semestre letivo). Ao navegar pelas linhas, uma visão comparativa do indicador de cores de cada aspecto pode ser visto na série histórica.

2.5 O Uso de diferentes recortes de dados de entrada

Outra capacidade do modelo é a sua aplicação em diferentes recortes de dados. Em nível organizacional, respeitados os níveis de acesso à informação, os dados de entrada para o modelo podem ser referentes à Universidade ou recortados para cada um dos cinco Centros e de suas Faculdades ou Cursos. Em qualquer desses quatro recortes é possível ainda filtrar os dados por turno (integral/matutino/noturno).

No nível docente, os dados providos aos professores podem ser úteis para seus processos de autogestão, uma vez que o recorte de dados admite muitas combinações. Alguns exemplos são ilustrados no Quadro 2.

: Algumas Combinações de Recorte de Dados de Entrada para o Modelo

Nos Anexos (A 1 Recorte de Dados do Gráfico: PUC-Campinas ),(B 1 Recorte de Dados do Gráfico: PUC-Campinas ), (C 1 Recorte de Dados do Gráfico: PUC-Campinas ), (D 1 Recorte de Dados do Gráfico: PUC-Campinas ) e (E 1 Recorte de Dados do Gráfico: PUC-Campinas ) podem ser observados exemplos dos gráficos disponíveis no portal da Universidade. Especificamente, cada um deles apresenta: Indicadores de Cores em Perspectiva Bidimensional - Qualidade e Participação; Gráfico de Barras de Comparativo Histórico da Média de Qualidade de cada Aspecto; Gráficos de Barras de Média de Qualidade de cada Aspecto; Gráfico de Linhas Comparativo Histórico Sintético da Média Geral de Qualidade e de Porcentagem de Participação dos Alunos; Gráfico de Linhas de Comparativo Histórico da Média de Qualidade por Aspecto.

3 Considerações Finais

A proposta apresentada, estudo dos dados quantitativos, introduzindo o conceito de aspecto nas diversas categorias das atividades do professor em sala de aula, permitiu o aprimoramento da análise da série histórica das avaliações feitas pelos alunos de 2007 a 2012. Ademais, apresenta-se como mais uma importante ferramenta aos gestores e oferece aos professores uma nova perspectiva para refletir sobre seu desempenho docente e buscar aprimoramento.

Embora admitindo que o índice de respondentes não tenha aumentado como esperado, houve avanços significativos ao longo do processo. Ressaltar aqui o processo mais do que o produto torna-se prioritário, principalmente tendo como foco as atividades do professor em sala de aula.

Para Brasil Reges et al. (2007)BRASIL REGES, Antonio; BARBOSA, Clara Irene Veiga; RODRIGUES, Francisco de Paula Marques; BLOIS, Maria Dias; CUNHA, Myrian Siqueira da; XAVIER, Regina Trilho Otero. O processo da avaliação institucional como multiplicador de iniciativas para o aperfeiçoamento docente - 2ª parte. Avaliação, Campinas; Sorocaba, v. 12, n. 4, p. 663-684, 2007., privilegiar e/ou focar no professor o início da avaliação, parece ser a estratégia mais adequada para, também, sensibilizar os alunos a participarem gradativamente do processo. Cunha enfatiza (1985, p. 45)CUNHA, Maria Isabel da. O bom professor e sua prática. Campinas, SP: Papirus, 1989. que “o professor é a principal fonte de conhecimento sistematizado. Ele é o centro e o sujeito da atividade. Estimula muito o aluno a participar dessa atividade que lhe pertence por ‘dever’ de professor”.

Considera-se fundamental que os professores incentivem os alunos a participarem da avaliação. Brasil Reges et al. (2007)BRASIL REGES, Antonio; BARBOSA, Clara Irene Veiga; RODRIGUES, Francisco de Paula Marques; BLOIS, Maria Dias; CUNHA, Myrian Siqueira da; XAVIER, Regina Trilho Otero. O processo da avaliação institucional como multiplicador de iniciativas para o aperfeiçoamento docente - 2ª parte. Avaliação, Campinas; Sorocaba, v. 12, n. 4, p. 663-684, 2007. lembra que, se os professores confiarem no caráter formativo e sentirem-se protagonistas do processo, eles saberão institucionalizar espaços à avaliação enfatizando a importância dessa cultura no processo ensino-aprendizagem.

É preciso ressaltar também os princípios éticos do processo, a confidencialidade, a imparcialidade, a equidade e o compromisso com o conhecimento, que são fundamentais para o seu êxito e sua validade.

Também é preciso tomar cuidado com o que Morosini (2001, p. 89)MOROSINI, Marília Costa. Qualidade da educação universitária: isomorfismo, diversidade e eqüidade. Interface - Comunicação, Saúde, Educação, Botucatu, v. 5, n. 9, p. 89-102, 2001. denomina de “fadiga da avaliação”. Para ela dúvidas são colocadas advindas das expectativas criadas de que a avaliação seria a palavra mágica para a resolução dos problemas das instituições de educação superior. Uma questão central congrega tais dúvidas: “o que foi feito com a enorme riqueza de informações obtidas”?

Sem dúvida, os avanços alcançados ao longo do desenvolvimento da Avaliação do Ensino da PUC-Campinas demonstram, principalmente, que a existência de uma série histórica e a análise de seus dados torna-se um importante instrumento para a melhoria da qualidade de ensino na Instituição, atendendo assim a um dos objetivos da missão da PUC-Campinas, o de capacitar os seus professores, trazendo subsídios para a gestão e a reformulação dos projetos pedagógicos e reflexões por parte dos professores sobre sua prática docente. Esse processo se mostra consistente e deve ser mantido para que se consolide uma cultura de avaliação na Universidade.

Apesar dos relevantes avanços do processo de Avaliação do Ensino, permanecem alguns desafios a serem superados. Em especial, a preocupação com o aumento do índice de respondentes, o aprimoramento do processo de socialização e discussão dos resultados da avaliação nas Faculdades e Centros, assim como o retorno dos resultados à totalidade do corpo discente.

Anexo A – Visão Parcial da Série Histórica dos Indicadores em Perspectiva Bidimensional (Código de Cores)(1 1 Recorte de Dados do Gráfico: PUC-Campinas )

ANEXO B – Gráfico de Barras de Comparativo Histórico da Média de Qualidade de cada Aspecto(2 1 Recorte de Dados do Gráfico: PUC-Campinas )

ANEXO C – Gráficos de Barras de Média de Qualidade de cada Aspecto, para o 1º semestre de 2008 e o 2º semestre de 2012, respectivamente(3 1 Recorte de Dados do Gráfico: PUC-Campinas )

ANEXO D – Gráfico de Linhas Comparativo Histórico da Média Geral de Qualidade e de Porcentagem de Participação dos Alunos(4 1 Recorte de Dados do Gráfico: PUC-Campinas )

ANEXO E – Gráfico de Linhas de Comparativo Histórico da Média de Qualidade para os Aspectos nº 1 e nº 9, respectivamente(5 1 Recorte de Dados do Gráfico: PUC-Campinas )

ANEXO E – Gráfico de Linhas de Comparativo Histórico da Média de Qualidade para os Aspectos nº 1 e nº 9, respectivamente(6 1 Observação: Anexos obtidos em documento eletrônico disponível em http://intranet.puc-campinas.edu.br. Acesso em: 26 jul. 2013. )

Referências

- A CONSTITUIÇÃO do Grupo de Trabalho “Avaliação do Ensino”: diretrizes, metodologia, objetivos e atribuições das instâncias envolvidas. Cadernos de Avaliação, Campinas, n. 4, p. 19-22, 2007.

- BRASIL REGES, Antonio; BARBOSA, Clara Irene Veiga; RODRIGUES, Francisco de Paula Marques; BLOIS, Maria Dias; CUNHA, Myrian Siqueira da; XAVIER, Regina Trilho Otero. O processo da avaliação institucional como multiplicador de iniciativas para o aperfeiçoamento docente - 2ª parte. Avaliação, Campinas; Sorocaba, v. 12, n. 4, p. 663-684, 2007.

- BRITO, Márcia Regina Ferreira de. O SINAES e o ENADE: da concepção à implantação. Avaliação, Campinas; Sorocaba, v. 13, n. 3, p. 841-850, 2008.

- CUNHA, Maria Isabel da. O bom professor e sua prática. Campinas, SP: Papirus, 1989.

- DIAS SOBRINHO, José. Avaliação e transformações da educação superior brasileira (1995-2009): do Provão ao SINAES. Avaliação, Campinas; Sorocaba, v. 5, n. 1, p. 195-224, 2010.

- INEP. SINAES. Disponível em: <http://www.inep.gov.br/superior/SINAES>. 2004. Acesso em: 20 out. 2009.

» http://www.inep.gov.br/superior/SINAES - LEMOS FILHO, Arnaldo; PÁDUA, Elisabete Matallo Marchesini de; BARIANI, Isabel Cristina Dib; RODRIGUES, Kátia Regina Martini; MEGID, Maria Auxiliadora Bueno Andrade. Avaliação docente: Um importante componente do processo de auto-avaliação institucional. Cadernos de avaliação, Campinas, n. 6, p. 21-53, 2009.

- LEMOS FILHO, Arnaldo; BARIANI, Isabel Cristina Dib; FRANÇA, Carlos Marshal; TREVISAN, Claudia Lúcia; GRANJA, Ivan; RODRIGUES, Kátia Regina Martini; PÁDUA, Elisabete Matallo Marchesini de. Avaliação do ensino: quando alunos e professores se avaliam. Cadernos de Avaliação, Campinas, n. 10, p. 37-49, 2012.

- MEYER JUNIOR, Victor; BARBOSA, Vera Maria. Avaliação docente: contribuição para a qualidade das instituições de Educação Superior. UNIrevista, São Leopoldo, v. 1, n. 2, 2006.

- MOROSINI, Marília Costa. Qualidade da educação universitária: isomorfismo, diversidade e eqüidade. Interface - Comunicação, Saúde, Educação, Botucatu, v. 5, n. 9, p. 89-102, 2001.

- POLIDORI, Malis Morosini; FONSECA, Denise Grosso da; LARROSA, Sara Fernanda Tarteer. Avaliação institucional participativa. Avaliação, Campinas, Sorocaba, v. 12, n. 2, p. 333-348, 2007.

- POLIDORI, Marlis Morosini; MARINHO-ARAUJO, Clayse Maria; BARREYRO, Gladys Beatriz. SINAES: perspectivas e desafios na avaliação da educação superior brasileira. Ensaio, Rio de Janeiro, v. 14, n. 53, p.425-436, 2006.

- RIBEIRO, Jorge Luiz Lordêlo de Sales. Avaliação das Universidades Brasileiras: as possibilidades de avaliar e as dificuldades de ser avaliado. Avaliação, Campinas; Sorocaba, v. 16, n. 1, p. 57-71, 2011.

- SANTANA, Flávia Feitosa. A dinâmica da aplicação do termo qualidade na educação superior brasileira. São Paulo: Senac, 2007.

-

1

Recorte de Dados do Gráfico: PUC-Campinas

-

1

Recorte de Dados do Gráfico: PUC-Campinas

-

1

Recorte de Dados do Gráfico: PUC-Campinas

-

1

Recorte de Dados do Gráfico: PUC-Campinas

-

1

Recorte de Dados do Gráfico: PUC-Campinas

-

1

Observação: Anexos obtidos em documento eletrônico disponível em http://intranet.puc-campinas.edu.br. Acesso em: 26 jul. 2013.

Datas de Publicação

-

Publicação nesta coleção

Mar 2016

Histórico

-

Recebido

11 Jul 2013 -

Aceito

3 Jan 2014